Viele Inhalte sind bei Suchmaschinen zwar indexiert, erscheinen aber nicht in den Suchergebnissen. Branchenakteure wie Google und Analysefirmen berichten, dass die Gründe meist in Kombination aus technischer SEO, Inhaltsqualität und Algorithmus‑Entscheidungen liegen. SE Ranking‑Experten wie Nico Kavelar haben in Tests an über 70 Websites wiederkehrende Muster identifiziert, die erklären, warum Seiten zwar im Index landen, aber kein Ranking erreichen.

Technische Ursachen: Wenn Indexierung nicht gleich Sichtbarkeit bedeutet

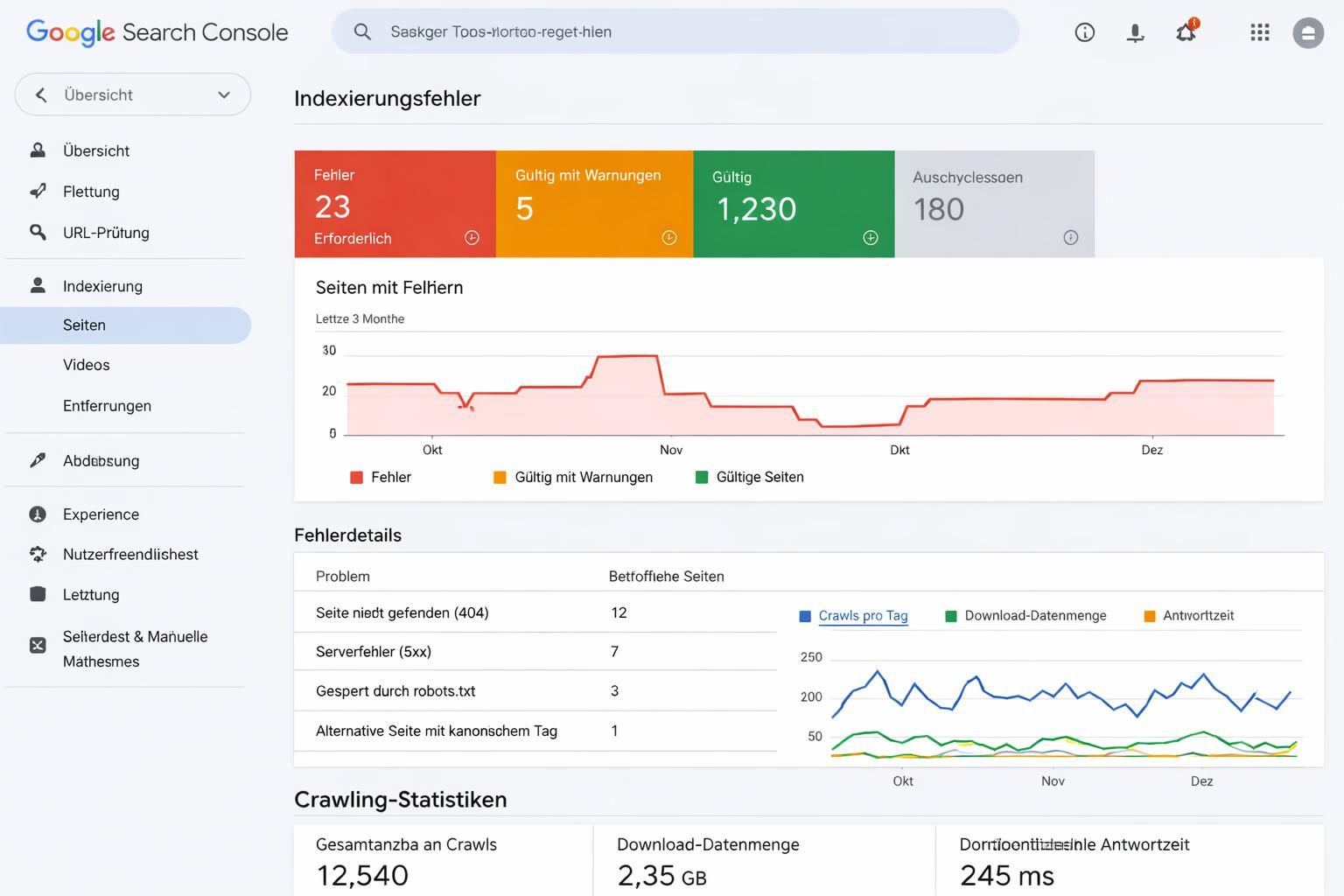

Suchmaschinen-Crawler bauen den Index, doch der Algorithmus entscheidet, welche Einträge in der Ergebnisliste sichtbar werden. Häufige technische Hindernisse sind fehlerhafte robots.txt-Regeln, versehentlich gesetzte noindex-Tags, falsche Canonical‑Angaben sowie 4xx- oder 5xx‑Statuscodes.

Die Google Search Console liefert präzise Fehlermeldungen wie «Gecrawlt – zurzeit nicht indexiert», Soft‑404 oder «Indexiert, obwohl durch robots.txt blockiert». SEO-Tools wie SE Ranking ergänzen die GSC‑Daten mit einem schnellen Site‑Audit, das blockierte Ressourcen, Weiterleitungsketten und Crawl‑Budget‑Probleme sichtbar macht. Diese technischen Fehler verhindern oft, dass Inhalte ihr Volumen an Keyword-Relevanz in Rankings umsetzen.

Fehlerbilder und ihre Folgen

Serverausfälle vermindern das Crawl‑Interesse; eine andauernde Folge sind Indexverluste. Blockierte JavaScript‑ und CSS‑Dateien sorgen dafür, dass Google Seiten nicht korrekt rendert und so Inhalte übersieht. Bei großen Websites kann ein überschrittenes Crawl‑Budget dazu führen, dass nur Prioritätsseiten regelmäßig gecrawlt werden. Suchmaschinen beurteilen dadurch die Relevanz und ziehen folgerichtig andere Seiten der Anzeige vor.

Inhalte, Qualität und Algorithmus: Warum indexiert nicht automatisch gerankt wird

Gute Indexierung ist eine Voraussetzung, aber die Sichtbarkeit hängt entscheidend von der inhaltlichen Qualität ab. Google priorisiert originäre, nützliche Inhalte, die Nutzeranfragen präzise beantworten und E‑E‑A‑T‑Kriterien erfüllen. Thin Content, Duplikate und maschinell generierte Texte ohne Mehrwert haben seit den Helpful‑Content‑Änderungen deutlich schlechtere Chancen, überhaupt gerankt zu werden.

SE Ranking‑Audits zeigen, dass Seiten mit hoher inhaltlicher Redundanz zwar indexiert sind, aber bei konkurrierenden Suchanfragen nicht in den Top‑Ergebnissen auftauchen. Ergänzend zeigen Untersuchungen zum Nutzerverhalten und generative Interfaces, dass veränderte Klickmuster und neue Interfaces das Ranking‑Verhalten beeinflussen können.

Praxisbeispiel aus Audits

In den getesteten Fällen halfen die Konsolidierung von Duplikaten, bessere interne Verlinkung und gezieltes Entfernen irrelevanter Seiten, die Indexqualität zu erhöhen. Zusätzlich beschleunigen gepflegte XML‑Sitemaps und strategisch gesetzte Backlinks die Verarbeitung durch den Algorithmus.

Konkrete Maßnahmen für betroffene Betreiber

Wer seine Inhalte indexiert sieht, aber kein Ranking erzielt, sollte systematisch vorgehen: Zuerst die GSC‑Berichte und das URL‑Inspektionstool prüfen, dann robots.txt, Meta‑Robots und Canonicals kontrollieren. Serverlogs zeigen 4xx/5xx‑Fehler, während Site‑Audits blockierte Ressourcen und Weiterleitungsketten aufdecken.

Praktische Schritte sind das Entfernen unbeabsichtigter noindex-Anweisungen, das Beheben von Serverproblemen, die Optimierung der Ladezeiten sowie die Verbesserung inhaltlicher Qualität und interner Verlinkung. Tools wie RankMath Instant Indexing oder die Google Indexing API können in Einzelfällen die Neuindexierung beschleunigen. Ergänzend empfiehlt sich gezieltes Social‑Sharing und qualitatives Linkbuilding, um Signale für Relevanz zu setzen. Weitere strategische Überlegungen finden sich in Artikeln zu Zero‑Click‑Search‑Strategien, die zeigen, wie veränderte Suchschnittstellen das Auffindverhalten beeinflussen.

Insgesamt bleibt klar: Die Indexierung ist nur ein Schritt. Erst wenn technische Rahmenbedingungen stimmen und Inhalte echten Mehrwert liefern, kann der Algorithmus eine Platzierung in den Suchergebnissen vergeben. Betreiber sollten daher GSC und spezialisierte SEO‑Tools kombinieren, um Ursachen präzise zu erkennen und nachhaltige Sichtbarkeit zu erreichen.